인스타그램이 사이버불링(온라인 괴롭힘), 증오발언 문제 해결에 인공지능(AI) 기술 적용을 확대하고 있다.

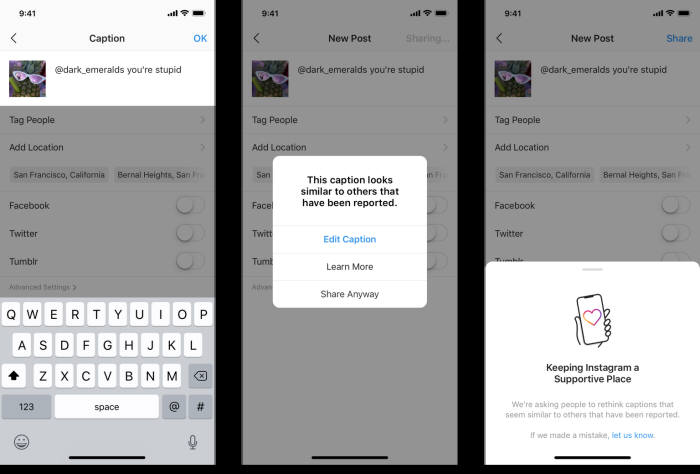

17일(현지시간) 테크크런치 등 외신에 따르면 인스타그램은 공격적인 캡션(사진와 함께 올리는 게시글)을 감지하기 위한 AI 시스템을 도입한다고 밝혔다. 이 기능은 일부 국가에서만 출시될 예정이며, 향후 몇 달 내 전 세계 이용자로 확대될 예정이다.

이 기능이 활성화된 지역에서는 작성 중인 불쾌한 게시물을 AI가 감지할 경우 이용자에게 경고 메시지를 보낸다. “게시하기 전 사용하는 단어를 다시 생각해보라”며 편집을 통해 표현을 수정할 여지를 준다.

이 기능은 인스타그램이 앞서 댓글 기능에 선보인 것과 유사한 방식이다. 불쾌한 댓글 감지에 도입됐던 AI필터가 사이버불링 문제 감소에 상당한 도움이 된 것으로 나타났다. 불쾌한 댓글과 캡션을 남기려는 이용자는 경고만 받을 뿐 콘텐츠 업로드 자체를 제한당하지는 않는다. 그러나 인스타그램은 작은 '넛지'가 사용자로 하여금 자신의 언어를 재고할 시간을 준다고 설명했다.

해당 기능은 혐오발언을 실질적으로 감소시키는 효과는 물론, 사용자 교육 효과도 있을 것으로 기대된다. 사용자가 규칙 위반으로 실제 계정을 정지당하기 전에 인스타그램 내에서 통용되는 여러 위반 사례를 알려주는 역할을 한다.

최근 인스타그램은 플랫폼 내에서 사이버불링으로 고통 받는 이용자들을 위해 '계정 음소거' '팔로워 삭제' '코멘트 필터' 등 다양한 기능을 출시해 왔다. 다만 외신은 “환영할만한 추가 기능이지만, 인스타그램 출시 10년 후에나 나왔다는 것은 실망스러운 일”이라며 “인스타그램 제품 디자인은 '타인을 해치려는 사용자들에 의해 서비스가 남용될 수 있는지'에 대한 사려 깊은 안목이 없는 사람들에 의해 이뤄졌다”고 평가했다.

이형두기자 dudu@etnews.com