한동대(총장 최도성)는 전산전자공학부 딥러닝 연구실이 세계 최초로 감정을 표현할 수 있는 다중화자 노래음성합성 인공지능(AI) '뮤즈SVS(MuseSVS)'를 개발했다고 2일 밝혔다.

노래음성합성(SVS)은 악보를 입력하면 노래음성을 합성하는 AI 기술이다. 기존 AI들은 대부분 노래를 부르는 음성만을 합성했다. 감정을 반영해 음성을 합성하는 AI는 아직까지 없었다.

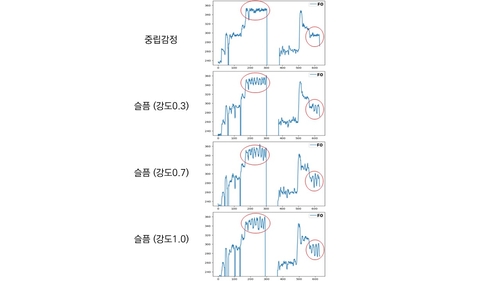

한동대가 개발한 '뮤즈SVS'는 악보와 함께 화자, 감정의 종류와 강도를 입력하면 그에 따라 음색, 비브라토, 볼륨이 다른 노래음성을 합성한다.

노래음성합성 AI에 최초로 적용된 통계적 음정 예측기와 문맥기반 음표길이 예측기는 감정표현을 위한 미세한 음정과 박자의 미세한 변화를 효과적으로 합성한 것이 특징이다.

김인중 전산전자공학부 교수는 “사람은 동일한 노래를 부를 때라도 음정, 박자, 볼륨의 미세한 변화를 통해 감정을 표현한다. 뮤즈SVS는 이런 미세한 변화를 데이터로부터 효과적으로 학습한다.”면서 “뮤즈SVS는 음정과 박자의 거시적인 흐름은 악보를 따르되, 미시적인 변화는 지정된 감정의 종류 및 강도에 따라 다르게 합성한다.” 고 말했다.

한동대 전산전자공학부 박사과정 김성재 씨가 주도하고, 김예원 석사과정생, 전제우 학부과정생이 참여해 개발한 이번 연구성과는 최근 세계 최고 저널인 'IEEE/ACM Transactions on Audio, Speech and Language Processing(TASLP)'에 발표됐다.

포항=정재훈 기자 jhoon@etnews.com