“사람이나 객체를 탐지하는 일은 간단하지만 '쓰레기 투기'처럼 의도를 갖춘 행위를 구분하기는 어려운 일입니다. 영상만으로 파악해 사람 일을 덜어주는 것이 우리가 만든 '딥뷰'의 개발 목표입니다.”

한국전자통신연구원(ETRI) 시각지능연구실은 시각 인공지능(AI) 딥뷰로 이전에 불가능했던 일을 가능하게 했다. 대표 사례가 쓰레기 투기 행위 포착이다. 쓰레기 투기 행위를 검출하는 모델을 구현해 일일이 지켜보지 않아도 현장을 잡아낼 수 있다. ETRI 7연구동 5층 시각지능연구실을 찾아 딥뷰의 쓰레기 투기 포착 영상을 접하고 적용된 원리에 대해 설명을 들었다.

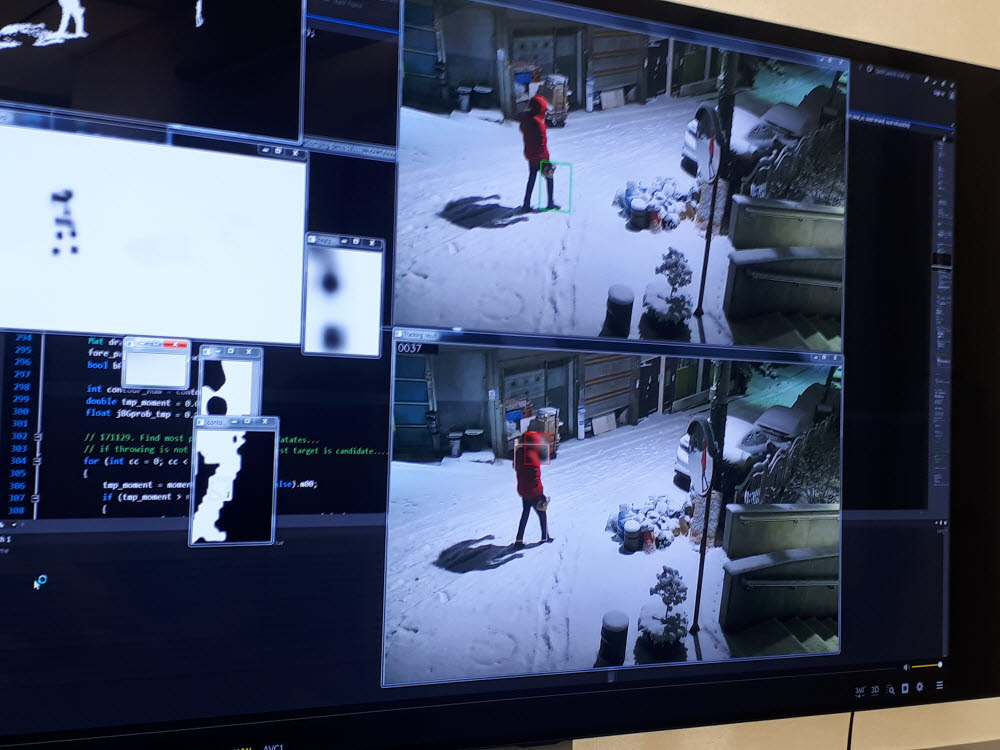

먼저 초창기 제품인 '버전1'이다. 연구진은 쓰레기 투기를 포착하는 첫 번째 기술을 버전1에 구현하면서 사람, 쓰레기 등 대상을 포착하고, 이들 사이 관계 규명에 집중했다. 버전1 영상은 쓰레기 투기자를 AI로 포착해 사각형으로 표시한다. 손에 들고 있는 쓰레기는 보다 작은 사각형으로 구분한다. 투기 행위가 이뤄지는지 여부는 사람과 쓰레기 사이 거리로 판별한다. 영상 속에서 투기자와 쓰레기 사이에 선이 표시되고, 이 선이 일정 수준을 넘어 길어지자 '투기 행위가 이뤄졌다'고 판단했다.

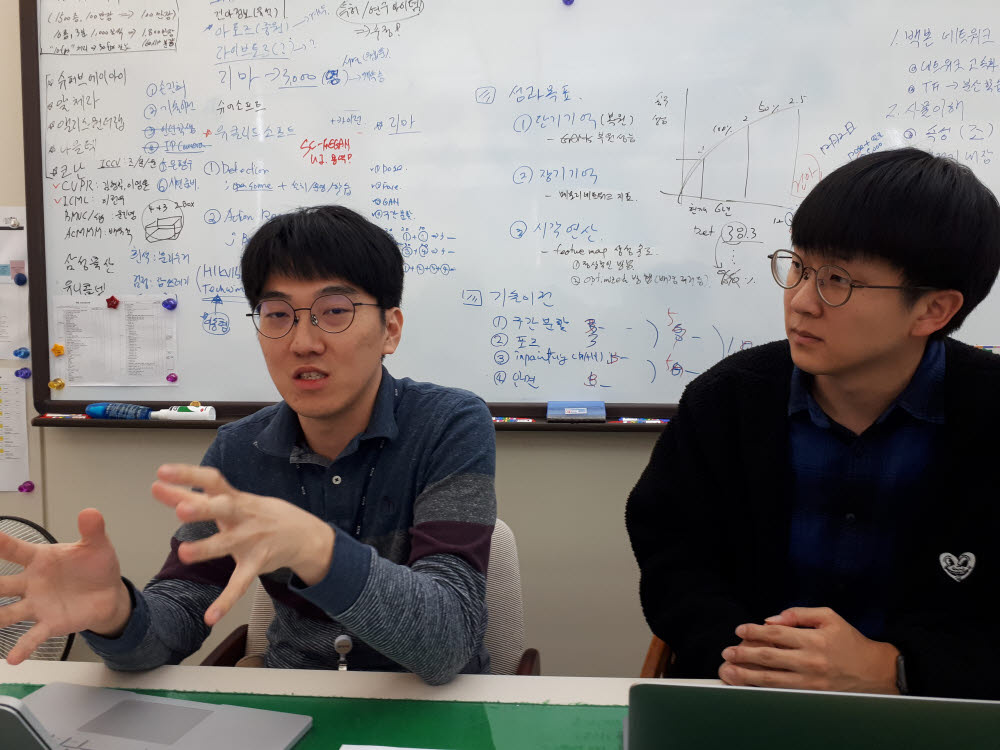

윤기민 선임연구원은 “사람이 아닌 AI를 통해 쓰레기 투기를 가려내려면 투기자와 쓰레기 사이 관계, 거리가 무엇보다 중요하다”면서 “버전1은 여기에 집중했다”고 설명했다.

새로운 딥뷰 버전은 이전과 다른 방식으로 쓰레기 투기를 포착한다. 영상에서 딥뷰는 쓰레기 대신에 사람에 집중해 각 사람 관절을 정밀 포착하고 이를 두드러지게 표현했다. 각 관절을 통해 읽어낸 자세로 투기 의도를 가려내는 방식이다.

함께 자리한 배강민 연구원은 “연구를 거듭하면서 몸을 굽히거나 손을 뻗어 물건을 던지는 자세에서 투기 의도를 읽어낼 수 있다는 것을 알게 됐고, 이를 딥뷰에 적용했다”고 말했다.

딥뷰는 투기자 상태를 읽어내는 방법론까지 적용해 매우 높은 정확도로 쓰레기 투기 행위를 잡아낸다. 윤 선임은 딥뷰는 실제 행정 현장에 적용할 수 있을 정도로 발전을 거듭했다고 말했다. “딥뷰의 쓰레기 투기 검출 정확도는 80% 수준으로, 추가 학습이나 개선작업으로 이를 더욱 높일 수 있다”면서 “지난해 이미 세종시와 서울 은평구에서 시범 운용까지 했다”고 설명했다.

딥뷰는 쓰레기 투기뿐 아니라 다양한 시각지능 분야에 활용 가능하다. 다른 활용 예시로 '스케치컬러(SC)-FEGAN(페이스에디팅GAN)'를 접할 수 있었다. 선글라스를 낀 사람의 사진에 몇 가지 조작을 가하자 이내 선글라스를 벗은 상태 얼굴이 떴다. 머리카락에 가려진 맨 이마를 드러내는 것도 가능했다.

윤 선임은 “AI로 영상과 사람을 학습하고 이해한 결과 딥뷰는 시각지능 분야에서 높은 성능을 갖추게 됐다”면서 “사람 관절부를 명확하게 추정하는 등 무궁무진한 영역에서 성능을 발휘할 수 있다”고 말했다.

대전=김영준기자 kyj85@etnews.com